目录

目录Python全系列 教程

3567个小节阅读:5930.9k

目录

鸿蒙应用开发

C语言快速入门

JAVA全系列 教程

面向对象的程序设计语言

Python全系列 教程

Python3.x版本,未来主流的版本

人工智能 教程

顺势而为,AI创新未来

大厂算法 教程

算法,程序员自我提升必经之路

C++ 教程

一门通用计算机编程语言

微服务 教程

目前业界流行的框架组合

web前端全系列 教程

通向WEB技术世界的钥匙

大数据全系列 教程

站在云端操控万千数据

AIGC全能工具班

A A

White Night

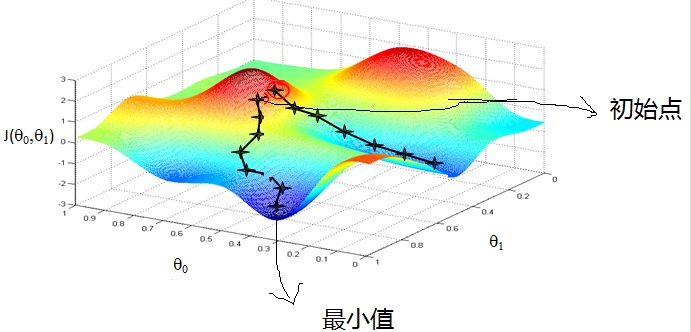

在最小化损失函数时,可以通过梯度下降法来一步步的迭代求解,得到最小化的损失函

数和模型参数值。

在机器学习中,对于很多监督学习模型,需要对原始的模型构建损失函数,接下来便是通

过优化算法对损失函数进行优化,最小化损失函数,以便寻找到最优的参数.于是,基于搜

索的梯度下降法就产生了。

梯度下降法是通过当前点的梯度的反方向寻找到新的迭代点,并从当前点移动到新的迭

代点继续寻找新的迭代点,直到找到最优解。

以下图为例:

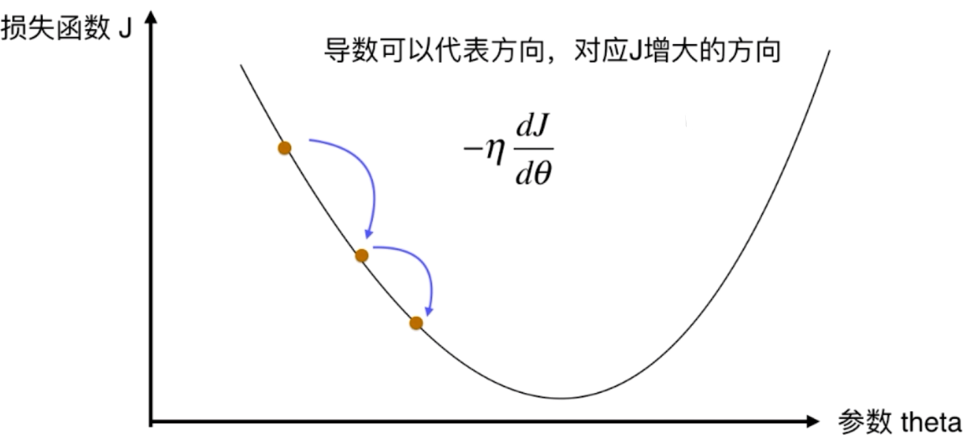

上图中,η 称为学习率(learning rate),有时候也写作α,其取值影响获得最优解的速度

通过这个公式,在梯度下降法中不断搜索最佳的θ值。

1. 梯度下降法是通过当前点的_______寻找到新的迭代点

A 梯度的反方向

B 梯度方向

C 随机方向

D 直线方向

2. 关于梯度下降法的学习率,下列说法正确的是:

A 学习率越大越好

B 学习率越小越好

C 学习率的取值影响获得最优解的速度

D 以上说法均不正确

1=>A 2=>C