目录

目录Python全系列 教程

3567个小节阅读:5928.9k

目录

鸿蒙应用开发

C语言快速入门

JAVA全系列 教程

面向对象的程序设计语言

Python全系列 教程

Python3.x版本,未来主流的版本

人工智能 教程

顺势而为,AI创新未来

大厂算法 教程

算法,程序员自我提升必经之路

C++ 教程

一门通用计算机编程语言

微服务 教程

目前业界流行的框架组合

web前端全系列 教程

通向WEB技术世界的钥匙

大数据全系列 教程

站在云端操控万千数据

AIGC全能工具班

A A

White Night

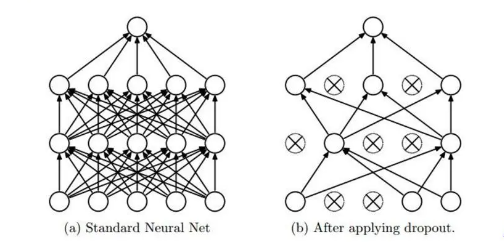

神经网络因为隐藏层的存在可以实现复杂的非线性拟合功能。但随着神经网络层数加

深,神经网络很容易发生过拟合现象(在训练集上表现很好,在未知的测试集上表现很

差,即“泛化能力差”)。

与很多机器学习算法一样,可以在待优化的目标函数上添加正则化项(例如L1、L2正

则),可以在一定程度减少过拟合的程度

可以将Dropout理解为对神经网络中的每一个神经元加上一道概率流程,使得在神经

网络训练时能够随机使某个神经元失效。

注意:

- 对于不同神经元个数的神经网络层,可以设置不同的失活或保留概率

- 如果担心某些层所含神经元较多或比其他层更容易发生过拟合,则可以将该层的失活概率设置得更高一些

1. 关于过拟合,下列说法正确的是:

A 发生过拟合说明模型训练得很好

B 在训练集上表现得很差

C 神经网络不可能发生过拟合

D 过拟合说明模型泛化能力差

2. 关于神经网络的Dropout,下列说法正确的是:

A Dropout是一种解决神经网络过拟合的有效手段

B 每个神经网络层的Dropout概率是相同的

C 若某层的神经元发生过拟合的可能性很大,则将该层的失活概率设置得低一些

D 以上说法均不正确

1=>D 2=>A