目录

目录Python全系列 教程

3567个小节阅读:5931.5k

目录

鸿蒙应用开发

C语言快速入门

JAVA全系列 教程

面向对象的程序设计语言

Python全系列 教程

Python3.x版本,未来主流的版本

人工智能 教程

顺势而为,AI创新未来

大厂算法 教程

算法,程序员自我提升必经之路

C++ 教程

一门通用计算机编程语言

微服务 教程

目前业界流行的框架组合

web前端全系列 教程

通向WEB技术世界的钥匙

大数据全系列 教程

站在云端操控万千数据

AIGC全能工具班

A A

White Night

在线性回归模型中,有一个同方差性假设,就是要求所有观测对回归模型的变异具有相同的贡献,以此为基础的回归方法称之为普通最小二乘法(OLS)。当因某些观测的变异较其他观测大而导致样本的方差不等时,就不能使用OLS方法了。如果观测的变异是可以通过其他变量进行预测,就可以使用加权最小二乘法(WLS)来拟合线性回归模型。WLS实际上是在回归中按观测量方差的倒数对观测进行加权,这样就会降低具有较大方差的观测记录对计算过程的影响。

例如在研究通货膨胀和失业率对股票价格的影响时,考虑到高市值的股票较低市值的具有更高的变异性(价格波动大),使用OLS法便不能很好地反应制定因素对变异性较大的股票的影响,这个时候就需要使用WLS方法来解决这个问题。

(1)加权回归对数据的要求和假设包括:

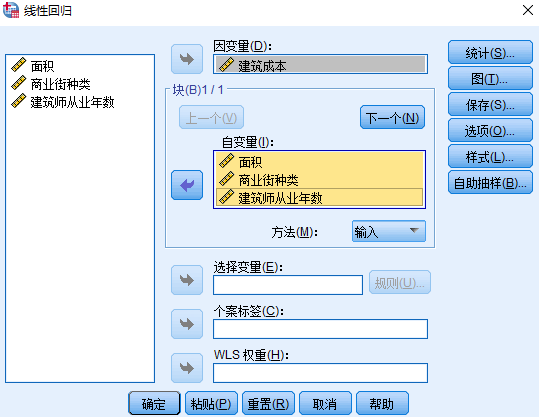

示例: 某开发商计划利用历史数据预测新建一个商业街的成本,现准备利用加权回归来进行分析

1. 方差诊断

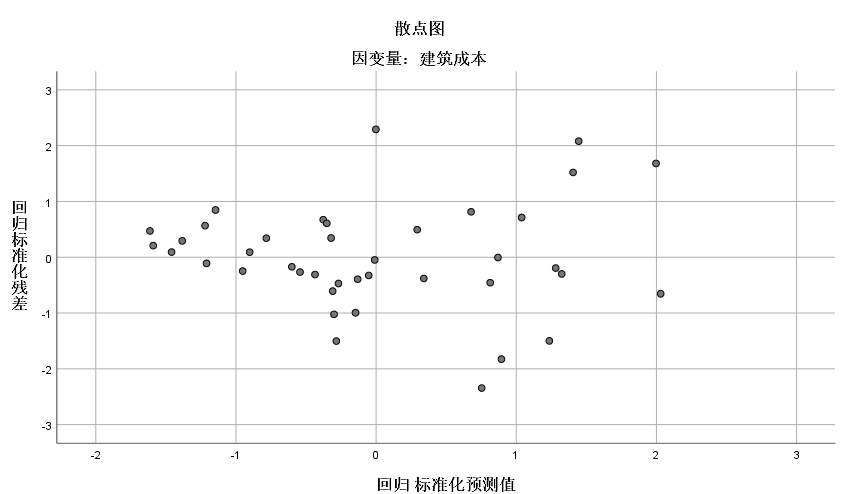

先利用OLS方法对原始数据建立简单线性模型,并绘制其残差对预测值的散点图,如果残差均匀分布在某条与横轴平行的横线附近说明样本的方差基本相等;反之,如果方差呈现明显的喇叭口形状或其他不规则形状,说明样本方差不相等,有必要进行WLS估计。

如果只有一个自变量,可以直接作因变量对自变量的散点图,观察因变量的分布是否均匀,判断方法与残差图相似。

导入数据

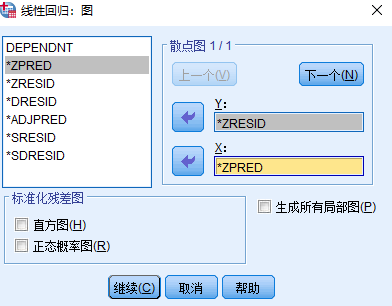

标准化预测值(StandardizedPredicted Value)选入x轴,标准化残差(StandardizedResidual)选入Y轴

上图是用OLS回归得到的标准化残差对标准化预测值的散点图。可见,随着预测值的增大,残差也有增大的趋势,故而可以否定OLS中关于同方差的假设,建议采用WLS方法对这个问题进行分析。

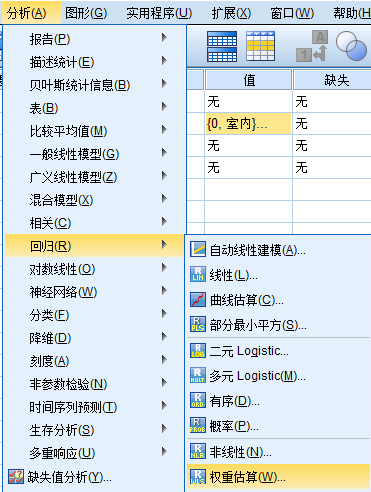

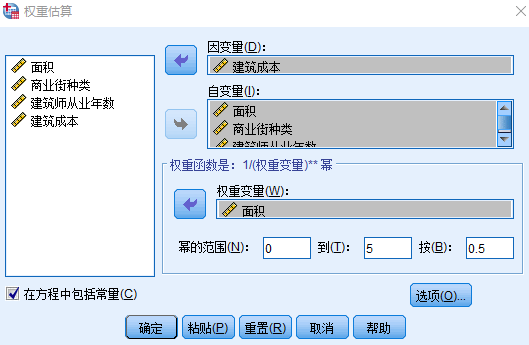

权重指数的幂的范围从0到5,步长为0.5

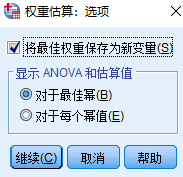

选项中将最佳权重保存为新变量

点击“确定‘“,在输出窗口中查看结果:

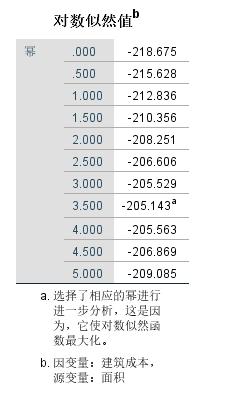

“对数似然函数值”表中,给出了指定步长内的所有对数似然值,使得这个对数似然值达到最大的指数就是最佳指数,表中右上角的小a标志就是最优值。

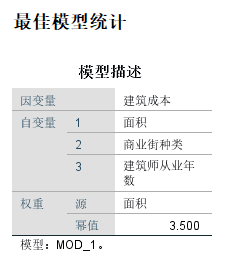

“模型描述”表格中,给出了加权估计模型的概要信息,包括因变量、自变量权重变量和最优权重。

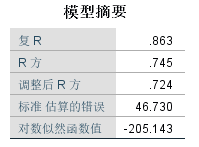

“模型摘要” 表格给出采用最佳指数建立的加权回归模型的拟合优度检验结果,可见,R方和调整R方都很大,说明权重指数为3.5时的加权回归模型拟合效果不错。

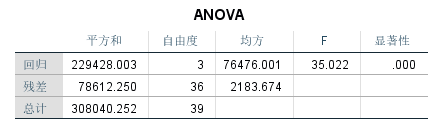

“方差分析表”是权重为3.5时所建立的加权回归模型的ANOVA表,从F统计量的显著性看远小于0.05,因此由加权回归模型所解释的变异系数远大于由残差所解释的变异系数,回归效果很好。

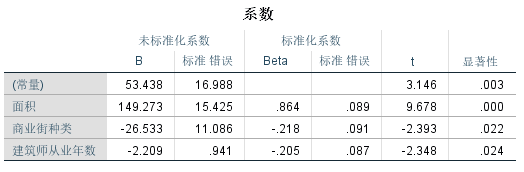

由系数估计结果可看出,各个变量系数及常数项的t检验的Sig的值均小于显著性水平0.05,因此加权回归模型的系数显著有效,