目录

目录Python全系列 教程

3567个小节阅读:5930.5k

目录

鸿蒙应用开发

C语言快速入门

JAVA全系列 教程

面向对象的程序设计语言

Python全系列 教程

Python3.x版本,未来主流的版本

人工智能 教程

顺势而为,AI创新未来

大厂算法 教程

算法,程序员自我提升必经之路

C++ 教程

一门通用计算机编程语言

微服务 教程

目前业界流行的框架组合

web前端全系列 教程

通向WEB技术世界的钥匙

大数据全系列 教程

站在云端操控万千数据

AIGC全能工具班

A A

White Night

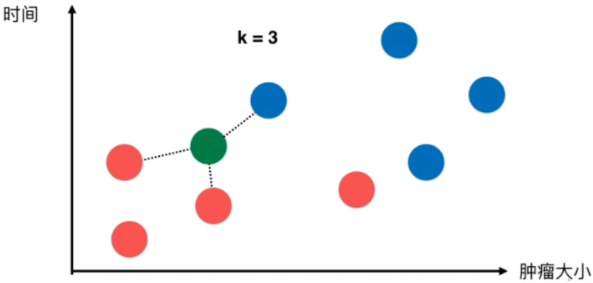

“近朱者赤,近墨者黑”——从训练数据集中找出和待预测样本最接近的K个样本,然后

投票决定待预测样本的分类;如果是回归问题,则求出K个样本的平均值作为待预测样本最

终的预测值

如果样本的多个特征值差别很大,或者样本特征的量纲不一致,导致样本间距离被某些

特征所主导,就应该考虑样本特征标准化的问题

1. 关于KNN算法,下列说法正确的是:

A KNN只能解决分类问题

B KNN只能解决回归问题

C KNN解决分类时,找出待预测样本最接近的K个样本,然后投票决定待预测样本的分类

D 以上说法均不正确

2. 关于z-score特征标准化,下列说法正确的是:

A 使用sklearn中的StandardScaler完成z-score特征标准化

B z-score特征标准化只要减去原特征数据的均值即可

C 如果样本特征的量纲不一致,不需要使用特征标准化

D 以上说法均不正确

1=>C 2=>A